2026-05-05

Codex Plus 额度不够用?首月 5 美金接 OpenCode Go,直接爽用一队强模型

这玩意我越看越觉得离谱。 Codex Plus 能力够,烦的是额度。 写代码、改 bug、补测试、读仓库、整理资料、起草文章,每一件都合理。可这些活一多,GPT 主模型额度很快就被吃干。 @gold tesla 佬做的 ,刚好打在这个痛点上。 OpenCode Go 当前首月 5 美金,之后 10 美金/月,以官方页…

这玩意我越看越觉得离谱。

Codex Plus 能力够,烦的是额度。

写代码、改 bug、补测试、读仓库、整理资料、起草文章,每一件都合理。可这些活一多,GPT 主模型额度很快就被吃干。

@gold_tesla 佬做的 opencode-bridge,刚好打在这个痛点上。

OpenCode Go 当前首月 5 美金,之后 10 美金/月,以官方页面为准。

它给的是 DeepSeek、Kimi、GLM、Qwen、MiniMax 这一组高额度模型。

opencode-bridge 负责把这组模型接进 Codex。

这一下,玩法就变了。

GPT 主模型继续做总控、复杂规划、风险判断和最终审核。

DeepSeek、Kimi、GLM、Qwen、MiniMax 负责干活。

对 Plus 用户来说,这个组合太香了。

额度很猛

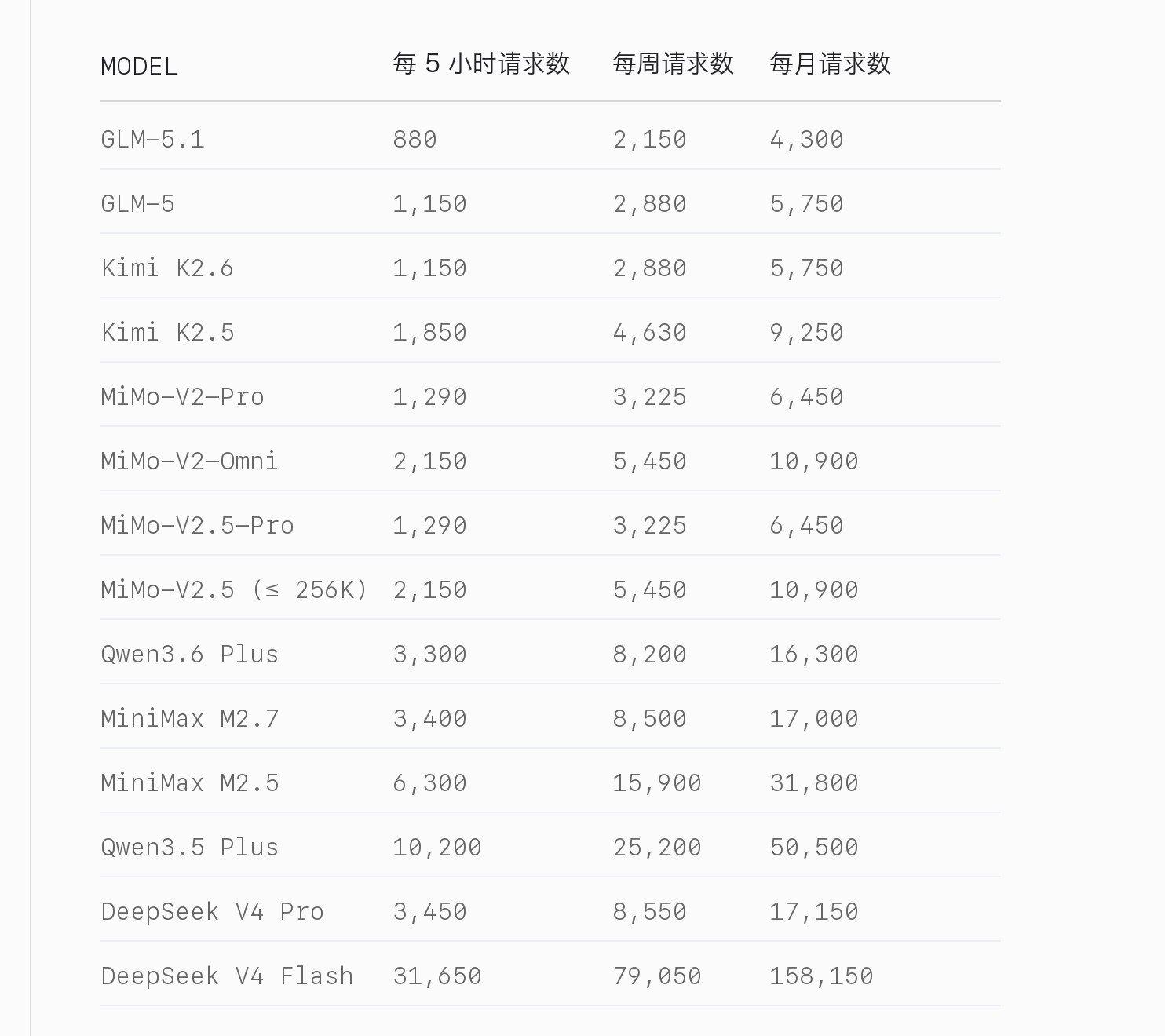

先看 OpenCode Go 当前页面给的估算,实际以官方为准。

DeepSeek V4 Pro,每月约 17150 次请求。

DeepSeek V4 Flash,每月约 158150 次请求。

Kimi K2.6,每月约 5750 次请求。

Qwen3.6 Plus,每月约 16300 次请求。

MiniMax M2.7,每月约 17000 次请求。

这几个数字摆出来,冲击力就很直接。

大量执行工作终于可以放心分出去。

代码小功能、bug 修复、测试补齐、文档改写、文章初稿、资料整理、调用链梳理、review 草稿,这些事都不该一直消耗 GPT 主模型额度。

DeepSeek V4 Pro 可以扛实现和调试。

Kimi K2.6 适合读仓库、扫结构、梳理调用链。

GLM、Qwen、MiniMax 也能处理不少文本、文档和执行类任务。

真正值钱的地方在这里,Codex 多了一队能干活的高额度外援。

安装不复杂

项目地址是 github.com/goldtetsola/opencode-bridge。

安装段不用展开成手册,核心就是把 bridge 跑起来,再让 Codex 认到它。

git clone https://github.com/goldtetsola/opencode-bridge bridge

cd bridge

cp opencode-go.env.example opencode-go.env

# 填好 OPENCODE_GO_API_KEY 后启动

./bin/start-proxy

curl http://127.0.0.1:4000/health \

-H "Authorization: Bearer sk-local-codex-bridge"

再把 config.toml.example 合并进 .codex/config.toml,把 orchestration/agents/*.toml 复制到 .codex/agents/。最后跑一条最小测试。

codex exec --sandbox read-only \

-c model_provider=opencode_bridge \

-m ocg-deepseek-v4-pro \

'Say: hello'

如果返回 hello,桥就通了。

装完怎么用

别把所有活都丢给 GPT 主模型。

主模型适合做三件事,拆任务、看风险、拍最终结果。

执行模型适合做另一批事,写第一版代码、修边界清楚的小 bug、补测试、整理资料、改文档、起草文章、扫调用链。

目前这属于第三方开源桥接工具。项目里的 agents 配置复制进自己的 Codex 目录后,它才会进入你的 Codex 工作流。

预算够、开发强度高,Pro 仍然最省心。原生体验、额度、稳定性都不用你操心。

但如果你现在主要是 Plus,又经常被额度卡住,OpenCode Go + opencode-bridge 就很值得试。

首月 5 美金,把一组高额度强模型接进 Codex。GPT 主模型少做重复执行,多做真正值钱的判断。

后面 AI 编程拼的是调度能力。

强模型、高额度模型、便宜模型,能不能编成一支真正能干活的队伍。

这也是我觉得 opencode-bridge 值得装的原因。

这一步最大的价值,是让 Codex 开始学会调兵。